Wo bringt generative KI im Zusammenhang mit Businessdaten aus SAP einen echten Mehrwert? Erste Anwendungsgebiete zeigen sich im Chatten mit SAP-Daten. So lassen sich etwa Businessdaten, wie Artikelstämme, Dokumentationen, Stücklisten oder Projektstrukturen abfragen. Ein zweites Szenario zeigt sich in der leichteren Bedienung komplexer SAP-Prozesse: Mit natürlicher Sprache lassen sich so etwa Kundenaufträge, Projekte oder Produkte aufrufen, ändern oder sogar anlegen. Vorab muss dazu intern entschieden werden, ob der Chatbot auf firmenspezifische Daten zugreifen und damit Wissen daraus ziehen und verarbeiten darf. Spätestens an dieser Stelle stellt sich die Frage: Cloud oder On-Premise?

On-Premise oder Cloud: Sicherheit versus Innovation?

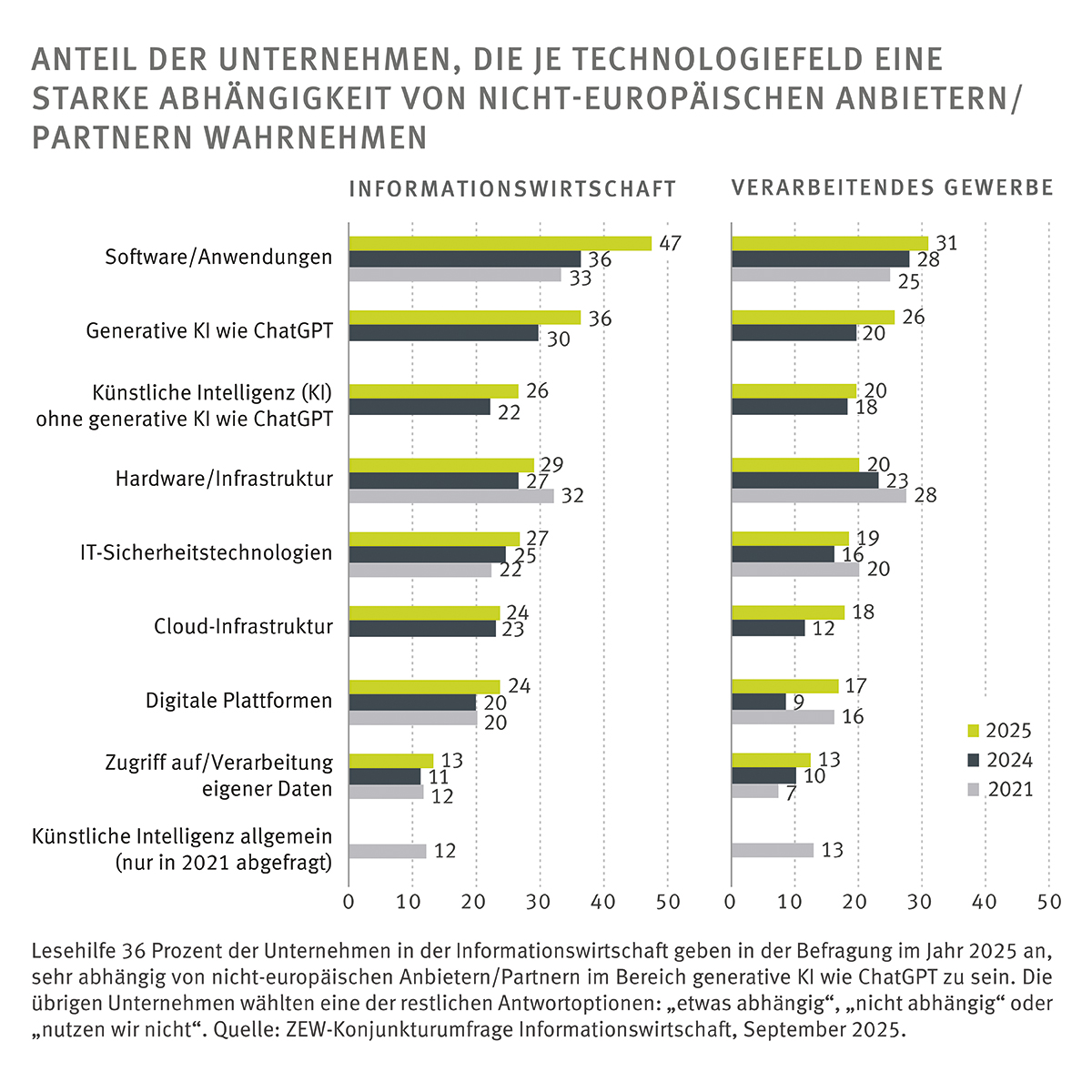

Viele Unternehmen nutzen SAP On-Premise, weil für sie die sicherheitsrelevanten Vorteile überwiegen: Trotz höherer Ressourcenanforderungen bieten sie eine höhere Kontrolle über sensible Daten. Dabei lassen sich lokale Systeme verbunden mit einem entsprechenden Aufwand auf die individuellen Bedürfnisse des Unternehmens zuschneiden, ein weiteres Argument gegen den Bezug von Cloud-Systemen. Auch beim Einsatz von KI gilt: Je weiter in der Cloud die Daten liegen, desto weniger Kontrolle über Datensicherheit bleibt beim Unternehmen. Heiß diskutiert wird dabei in SAP-Kreisen, dass die KI-Entwicklungen aus Walldorf sich nahezu ausschließlich auf Cloudtools fokussieren. Unternehmen, die SAP On-Premise nutzen, stecken beim Thema KI angesichts dieser Aussicht vor den Optionen, auf den Cloud-Bezug umzusatteln, ein anderes ERP-System einzuführen oder von KI-Funktionen abgeschnitten zu bleiben.

Serverfarmen meist unnötig

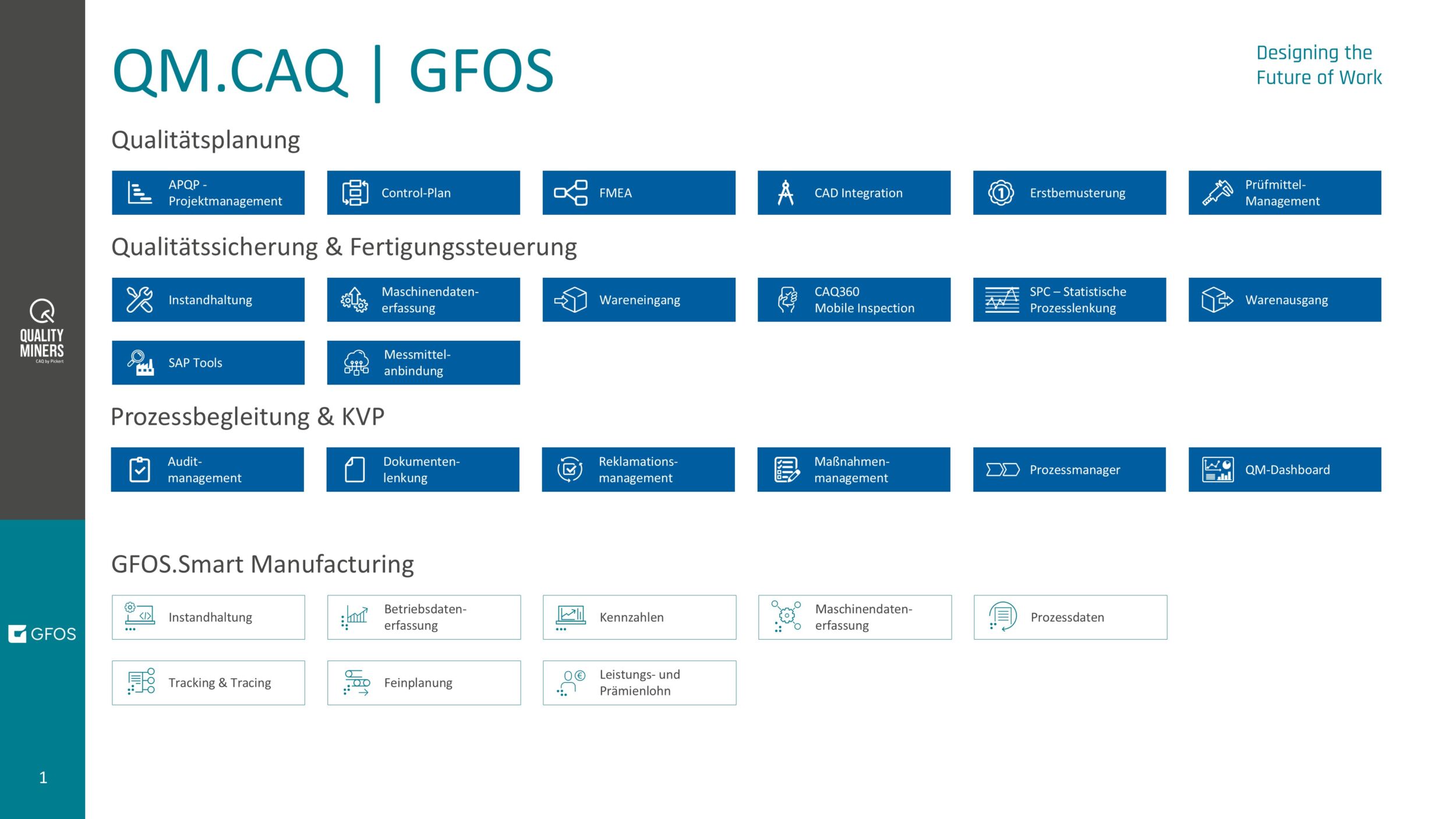

Mit jenen Unternehmen im Blick kam kürzlich das Milliarum AI Construction Kit auf den Markt. Damit erweitern Anwender ihr SAP-System um Funktionen auf Basis von KI. Mit vorkonfigurierten Funktionen für OpenAI, Azure OpenAI und lokal betriebenen Open Source-Modellen lassen sich Chatbots zügig in Unternehmen ausrollen. In Kürze sollen erste anwendungsspezifische Chatbots für SAP On-Premise folgen. Dabei sollen Unternehmen ihr Large Language Modell aussuchen und lokal mit einem eigenen KI-System verbinden können. Denn um mit den eigenen SAP-Daten zu chatten, braucht es keinen gigantischen Chatbot, der über 100 Sprachen spricht und mit mehreren hundert Milliarden Parametern antrainiert wurde, wenn am Ende nur Deutsch für begrenzte Use Cases zum Einsatz kommen soll. Eine Serverfarm dürfte für die meisten Anwendungsfälle im SAP-Umfeld also nicht notwendig sein.

Open Source LLM verfügbar

Der Einsatz von KI im SAP-Umfeld setzt nach der Definition der Ziele und Anwendungsszenarien die Wahl eines Hosters voraus, welcher den Sicherheitsanforderungen des Unternehmens gerecht wird. Dabei kann man sich zum einen für die großen Player am Markt entscheiden: OpenAI ist ein amerikanischer cloudbasierter Hoster, Microsoft Azure bietet vergleichbare Funktionen und erfüllt europäische Vorgaben. Eine Alternative stellen lokale Open Source Large-Language-Modelle (LLM) auf unternehmenseigener Hardware dar. Zu finden sind diese für diverse Anwendungsfälle etwa auf der Plattform Hugging Face. Das Fraunhofer Institut empfahl kürzlich deutschsprachig optimierte Modelle auf Basis Mistral 7b. Es läuft bereits auf Hardware, die von den Leistungsanforderungen her der eines Spiele-PCs ähnelt und bereits ab etwa 10.000 Euro erhältlich ist. Das Open Source Modell Mixtral 8x22b gilt derzeit als leistungsstärkstes europäisches LLM, dass fünf Sprachen fließend beherrscht und mit über 140 Milliarden Parametern antrainiert wurde. Es benötigt mindestens 300 GB Grafikspeicher für den produktiven Inference-Betrieb, welche nicht unbedingt über ein Nvidia-Rechenzentrum bereitgestellt werden müssen. Hier sind auch schon ältere NVIDIA-Grafikkarten-Generationen von der Leistung her vollkommen ausreichend und kostengünstig einsetzbar.